Künstliche Intelligenz (KI) hat auf Unternehmensebene den Sprung von der Experimentierphase zur obersten Priorität der Unternehmensleitung geschafft. Branchenübergreifend starten Unternehmen Pilotprojekte, Machbarkeitsstudien und erste Implementierungen, die darauf abzielen, die Entscheidungsfindung zu verbessern, Arbeitsabläufe zu automatisieren und die betriebliche Effizienz zu steigern.

Dennoch übersteigen die Erwartungen weiterhin die Ergebnisse. Zwar können viele Unternehmen auf erfolgreiche KI-Pilotprojekte verweisen, doch weitaus weniger haben diese ersten Erfolge in nachhaltige operative Auswirkungen umgesetzt. In ihrer weltweiten CEO-Umfrage 2026 unter 4.454 Führungskräften aus 95 Ländern berichtete die internationale Beratungsgesellschaft PwC, dass 56 % der Befragten „weder höhere Umsätze noch niedrigere Kosten durch KI“ verzeichneten.[1]

Dies verdeutlicht eine unangenehme Wahrheit: Die größte Herausforderung im Bereich KI, vor der die meisten Unternehmen heute stehen, ist nicht die Entwicklung von KI-Modellen, sondern die Schaffung von Umgebungen, in denen KI zuverlässig funktionieren kann. Die Skalierung von KI wird oft durch Probleme mit der Infrastrukturbereitschaft, der Datenzugänglichkeit und Ausführungssystemen behindert, die nie für KI-gesteuerte Abläufe konzipiert wurden.

In kontrollierten Pilotumgebungen zeigt KI in der Regel gute Leistungen. In realen Betriebsumgebungen behindert die Komplexität jedoch die Skalierung. Produktionssysteme erstrecken sich über mehrere Standorte, ältere Plattformen, proprietäre Geräte und fragmentierte Datenquellen. Über die technische Komplexität hinaus spielen in Betriebsumgebungen auch Governance-Strukturen, die Dynamik des Änderungsmanagements, funktionsübergreifende Abhängigkeiten und Faktoren der organisatorischen Bereitschaft eine Rolle, die Einfluss darauf haben, wie KI eingeführt und langfristig etabliert wird. Was in isolierten Pilotprojekten funktioniert hat, stößt oft auf Schwierigkeiten, wenn es mit den Realitäten des Unternehmensbetriebs konfrontiert wird.

Als Teilzeit-Chief AI Officer, der Unternehmen aus verschiedenen Branchen berät, beobachte ich dieses Muster immer wieder. In diesem Blogbeitrag wird untersucht, warum KI-Pilotprojekte oft nicht skaliert werden können, werden die wiederkehrenden Infrastruktur- und Konnektivitätsmuster identifiziert, die diesem Problem zugrunde liegen, und werden praktische Überlegungen für Führungskräfte dargelegt, die den Schritt vom Experimentieren hin zu nachhaltigen operativen Auswirkungen anstreben. Während KI sich vom Experimentieren hin zur operativen Abhängigkeit entwickelt, vergrößern Unternehmen, die zuerst die Infrastruktur bereitstellen, oft den Leistungsvorsprung.

Der Erfolg eines Pilotprojekts ist keine Garantie für den Erfolg bei der Skalierung

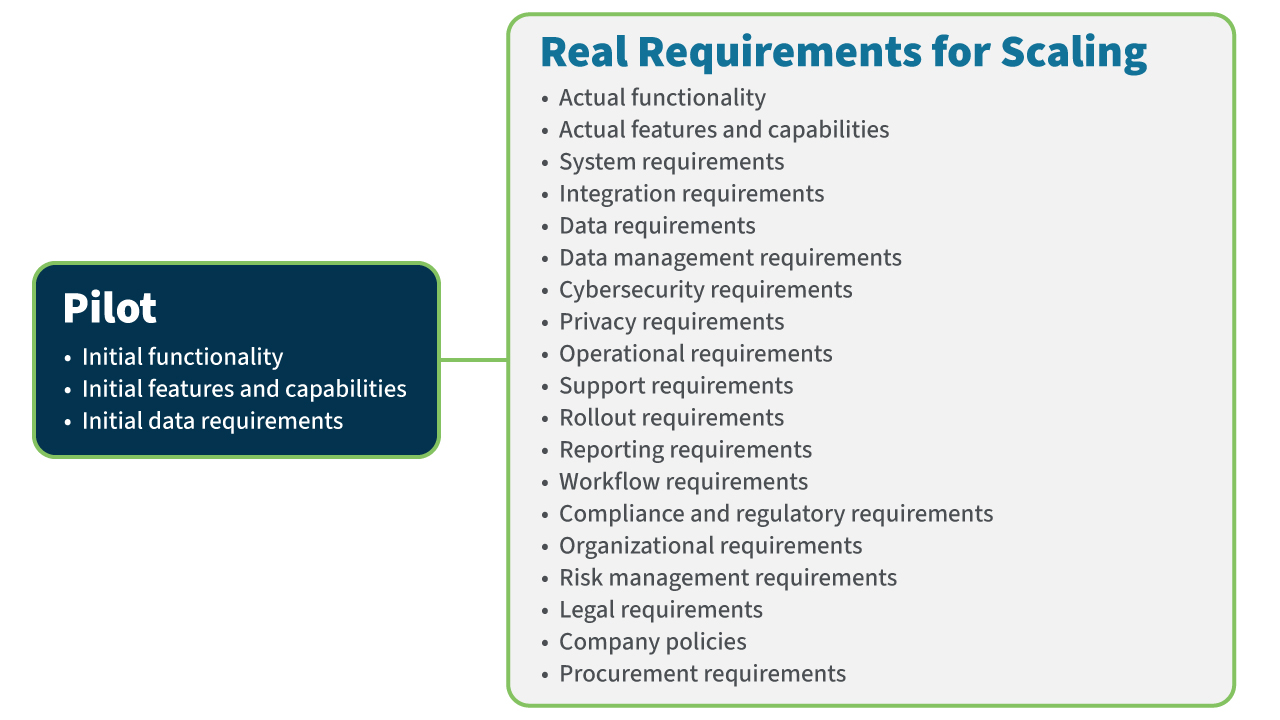

Pilotprojekte sind bewusst darauf ausgelegt, die Machbarkeit unter kontrollierten Bedingungen nachzuweisen. Sie sind eng gefasst, mit bescheidenen Mitteln ausgestattet und auf Schnelligkeit ausgelegt. Dies ist ein geeigneter Ansatz, um neue Innovationen, deren Ergebnisse ungewiss sind, auf effiziente und risikoarme Weise zu erproben und zu testen.

Die Pilotumgebung ist jedoch keine Miniaturausgabe der Produktionsumgebung. In Pilotprojekten werden Daten oft manuell aufbereitet. Integrationen werden als einmalige Verbindungen eingerichtet. Workflows, die automatisiert erscheinen, können dennoch auf menschliche Überprüfung oder Eingriffe angewiesen sein. Diese Abkürzungen ermöglichen es Teams, den Nutzen schnell zu validieren, ohne sich mit den umfassenderen infrastrukturellen Einschränkungen auseinandersetzen zu müssen.

Betriebsumgebungen sind unterschiedlich. Sie sind geprägt von jahrelangen schrittweisen Systemänderungen, Altgeräten, betrieblichen Einschränkungen und organisatorischen Grenzen. Daten liegen nicht in einer für die Nutzung geeigneten Form vor. Sie stammen aus heterogenen Systemen, können je nach Standort variieren und weisen häufig Unregelmäßigkeiten hinsichtlich Zuverlässigkeit oder Formatierung auf. Eine Skalierung erfordert, dass KI in dieser komplexen und anspruchsvollen Umgebung eingesetzt wird.

Branchenstudien untermauern diese Tatsache. Zwar experimentieren viele Unternehmen mit fortschrittlichen KI-Konzepten, doch nur ein kleiner Teil setzt diese erfolgreich in großem Maßstab um. Das Marktforschungsunternehmen Forrester schätzt, dass nur 10–15 % der KI-Projekte einen dauerhaften Einsatz in der Produktion erreichen und dass über 60 % der Pilotprojekte nicht über kontrollierte Umgebungen hinaus skaliert werden können.[2]

Diese Lücke ist selten auf Einschränkungen der KI zurückzuführen. In vielen Unternehmen werden Pilotprojekte als experimentelle Initiativen finanziert, während die für die Skalierung erforderliche Modernisierung der Infrastruktur außerhalb des Projektumfangs liegt. Infolgedessen werden die für den unternehmensweiten Einsatz erforderlichen Verbesserungen in den Bereichen Konnektivität, Integration und Betrieb weder finanziert noch priorisiert. Diese strukturelle Diskrepanz führt zu einem vorhersehbaren Engpass zwischen dem Proof of Concept und der operativen Umsetzung.

Das Pilotprojekt hat gezeigt, dass die KI funktionieren kann. Bei der Skalierung stellte sich jedoch heraus, dass das Unternehmen nicht darauf vorbereitet war, sie zu unterstützen. Diese Lücke sollte für Management ein Weckruf sein. Da KI zunehmend in operative Entscheidungsprozesse eingebunden wird, stellen Schwachstellen in der Infrastruktur nicht mehr nur geringfügige Ineffizienzen dar, sondern werden zu potenziellen Quellen für operative und finanzielle Risiken.

Vier infrastrukturelle Hindernisse, die den großflächigen Einsatz von KI behindern

Aus Sicht der betrieblichen Infrastruktur stoße ich unabhängig von der Branche immer wieder auf dieselben vier Probleme, die beim Übergang vom Pilotprojekt zur Skalierung auftreten. Diese sind:

- Maßgeschneiderte Integrationen sind nicht skalierbar. Frühe KI-Initiativen stützen sich häufig auf individuell entwickelte Integrationen wie einmalig erstellte Anwendungsprogrammierschnittstellen (APIs), Skripte oder Punkt-zu-Punkt-Datenpipelines, die speziell für einen Pilot-Anwendungsfall erstellt wurden. Diese Integrationen ermöglichen zwar eine schnelle Umsetzung, sind jedoch selten auf unternehmensweite Zuverlässigkeit, Governance oder die Wiederverwendung in mehreren KI-Anwendungen ausgelegt.

Mit dem Aufkommen weiterer Anwendungsfälle sammeln sich in Unternehmen instabile Verbindungen an, die schwer zu warten und bei deren Erweiterung Risiken bestehen.

- Unfähigkeit, Daten aus Betriebsanlagen zu erfassen. Ein erheblicher Teil der Daten, auf die KI angewiesen ist, stammt aus Quellen außerhalb traditioneller Unternehmens-IT-Systeme. So generieren beispielsweise Anlagen, Maschinen und spezialisierte Betriebsplattformen in Fabrikhallen und Außenstandorten einen Großteil der Daten, die KI-Modelle benötigen. Diese Art von Daten ist jedoch nicht immer verfügbar oder leicht zugänglich. Ältere Anlagen in Industrie- und Fertigungsbetrieben wurden für eine Umgebung vor dem Zeitalter der Vernetzung konzipiert. Die Daten bleiben auf der Anlage selbst oder in separaten proprietären Betriebsnetzwerken (OT-Netzwerken) eingeschlossen. Andere sind nicht mit den Sensoren ausgestattet, die zur Erfassung der von KI-Modellen benötigten Signale erforderlich sind.

Wenn Betriebsdaten unvollständig, inkonsistent oder schwer zugänglich sind, arbeiten KI-Systeme mit blinden Flecken. Die Erkenntnisse werden unvollständig. Die Modelle bleiben hinter ihren Möglichkeiten zurück. KI kann nicht optimieren und auf das reagieren, was sie nicht sehen kann.

- Unfähigkeit,die Umsetzung von KI-generierten Erkenntnissen zuautomatisieren. Viele KI-Systeme generieren zwar erfolgreich Vorhersagen, Empfehlungen oder Warnmeldungen, verfügen jedoch über keine Mittel, um zuverlässig und autonom Maßnahmen auszulösen. Die Umsetzung von KI-Ergebnissen erfordert in der Regel eine Integration in Betriebssysteme, um Arbeitsabläufe zu initiieren, Unternehmenssysteme zu aktualisieren, Betriebsparameter anzupassen oder mit Anlagen und Feldressourcen zu interagieren.

In Pilotumgebungen wird diese Einschränkung oft überdeckt, da Teams die KI-Ergebnisse manuell überprüfen und selbst Maßnahmen ergreifen oder sich auf temporäre Integrationen stützen, die für einen einzelnen Anwendungsfall erstellt wurden. Auf Unternehmensebene sind diese einmaligen Integrationen nicht nachhaltig. Wenn Betriebssysteme nicht konsistent miteinander verbunden oder in Ausführungsworkflows integriert sind, kann KI reale Prozesse nicht zuverlässig beeinflussen. Das Ergebnis ist „Erkenntnis ohne Umsetzung“, wobei KI zwar analytischen Wert demonstriert, aber keine messbaren betrieblichen Auswirkungen erzielt.

- Die Infrastruktur ist nicht für KI-gesteuerte Abläufe ausgelegt. Die Skalierung von KI erfordert eine Betriebsinfrastruktur, die auf kontinuierlichen Datenfluss, Systemerreichbarkeit und automatisierte Ausführung in verteilten Umgebungen ausgelegt ist. Unternehmen benötigen zuverlässige Datenströme, Systeme, auf die jederzeit zugegriffen werden kann, sowie eine weltweit überwachte Konnektivität, Sicherheit und Governance.

Ein Teil der Unternehmens- und Betriebsinfrastruktur wurde ursprünglich in erster Linie auf Verfügbarkeit und lokale Zuverlässigkeit ausgelegt und verwaltet, nicht auf den kontinuierlichen Datenaustausch zwischen Standorten, Systemen und Partnern. Die Konnektivität wird oft fragmentiert implementiert, die Transparenz beschränkt sich auf einzelne Systeme oder Standorte, und die Datenverfügbarkeit wird nicht konsequent als betriebliche Anforderung überwacht. Infolgedessen läuft die Infrastruktur zwar technisch gesehen, kann aber dennoch nicht den vorhersehbaren, unternehmensweiten Datenzugriff gewährleisten, den KI-Systeme erfordern.

Skalierung ist eine Management

Es ist verlockend, Skalierungsprobleme als technische und betriebliche Herausforderungen zu betrachten, die von KI- oder IT-Teams gelöst werden müssen. In Wirklichkeit reichen die hier beschriebenen Einschränkungen jedoch über organisatorische, architektonische und betriebliche Grenzen hinaus. Sie betreffen die Kapitalallokation, Governance-Strukturen, Modernisierungsprioritäten und die funktionsübergreifende Koordination.

Die Skalierung von KI ist nicht einfach nur die Ausweitung eines Pilotprojekts. Es handelt sich vielmehr um eine Herausforderung hinsichtlich der Unternehmensreife.

Für Führungskräfte in Unternehmen ist dieser Perspektivwechsel von entscheidender Bedeutung. Da KI zunehmend in Entscheidungsprozesse und betriebliche Arbeitsabläufe integriert wird, werden Infrastrukturlücken nicht mehr nur als Effizienzprobleme betrachtet, sondern als potenzielle Quellen für betriebliche und geschäftliche Risiken. Inkonsistente Daten, instabile Integrationen und eingeschränkte Transparenz untergraben das Vertrauen in die Automatisierung und verlangsamen deren Einführung in Unternehmen.

Unternehmen, die diese grundlegenden Herausforderungen frühzeitig angehen, verschaffen sich einen überproportionalen Vorteil. Diejenigen, die dies hinauszögern, müssen oft feststellen, dass ihre Konkurrenten KI schneller skalieren, Umsetzungssysteme tiefer in ihre Strukturen integrieren und Leistungserwartungen auf eine Weise steigern, die nur schwer zu erreichen ist.

Was Führungskräfte als Nächstes tun sollten

Um den Schritt vom Experimentieren hin zu konkreten Auswirkungen auf das Unternehmen zu vollziehen, müssen Führungskräfte den Begriff „KI-Bereitschaft“ über die Modellentwicklung hinaus erweitern. Die Skalierung sollte als Initiative zur Modernisierung des Unternehmens betrachtet werden und nicht als Erweiterung eines Pilotprojekts.

Die Skalierung von KI erfordert ein abgestimmtes Vorgehen zwischen IT, Betriebstechnik, Sicherheit und Management. Die Bereitschaft der Infrastruktur und die Konnektivität sollten als unternehmensweite Prioritäten behandelt werden.

Diese Maßnahmen führen dazu, dass KI den Sprung von vereinzelten Experimenten hin zu einer dauerhaften Einsatzfähigkeit schafft.

- Berücksichtigen Sie Konnektivität und Datenverfügbarkeit bei Skalierungsentscheidungen. Prüfen Sie bei der Entscheidung, ob ein Pilotprojekt fortgesetzt werden soll, ob die erforderlichen Datenquellen zuverlässig zugänglich sind und ob die Integrationen den Einsatz in der Produktion unterstützen können. Falls eine Modernisierung erforderlich ist, nehmen Sie diese in die Roadmap und das Finanzierungsmodell auf.

- Entwerfen Sie Pilotprojekte unter Berücksichtigung des Betriebs. Gestalten Sie Pilotprojekte so, dass sie das künftige Betriebsumfeld widerspiegeln. Testen Sie nicht nur die Modellleistung, sondern auch die Konnektivität, die Arbeitsabläufe bei der operativen Umsetzung sowie die für die Bereitstellung erforderlichen Steuerungsmechanismen.

- Schaffen Sie unternehmensweite Transparenz über die betriebliche Infrastruktur. Führen Sie eine Bestandsaufnahme durch und verschaffen Sie sich einen Überblick darüber, welche Ressourcen vernetzt sind, woher die Daten stammen und wo Lücken in Bezug auf Zuverlässigkeit oder Governance bestehen. Diese Transparenz verringert Überraschungen bei der Skalierung.

- Investieren Sie gezielt in eine Infrastruktur, die KI-gesteuerte Abläufe unterstützt. Bewerten Sie Infrastrukturinvestitionen nicht nur hinsichtlich der Verfügbarkeit, sondern auch hinsichtlich ihrer Fähigkeit, einen kontinuierlichen Datenaustausch, unternehmensweite Überwachung und sichere Automatisierung in großem Maßstab zu unterstützen.

Abschließende Gedanken und abschließende Hinweise

Der Erfolg von KI hängt zunehmend nicht nur davon ab, wie intelligent die Systeme sind, sondern auch davon, wie gut sie vom Unternehmensumfeld unterstützt werden. Unternehmen, die diese Tatsache erkennen, gehen über den Erfolg von Pilotprojekten hinaus und verzeichnen messbare Verbesserungen bei der betrieblichen Leistung.

Die Frage ist nicht mehr, ob KI Erkenntnisse liefern kann. Die Frage ist vielmehr, ob Unternehmen die Infrastruktur, die Vernetzung und die Steuerungsmechanismen aufbauen, die erforderlich sind, damit KI zuverlässig und in großem Maßstab eingesetzt werden kann.

Diejenigen, die dies tun, werden den Schritt vom Experimentieren zur Transformation vollziehen. Diejenigen, die dies nicht tun, werden vielleicht weiterhin Pilotprojekte feiern, während sie auf die Wirkung warten.

Wenn Ihre KI-Initiativen nicht in die Produktion überführt werden können, sind sie möglicherweise auf Betriebsdaten, Remote-Ressourcen oder veraltete Infrastruktur angewiesen, um erfolgreich zu sein. Kontaktieren Sie uns, um zu erfahren, wie die Infrastrukturmanagement-Lösungen von Digi die Konnektivität, Transparenz und Kontrollebene bieten, die KI erst möglich machen.

Häufig gestellte Fragen zur Skalierbarkeit von KI in Unternehmen

Welche entscheidenden Fragen sollte ich stellen, um festzustellen, ob unsere betriebliche Infrastruktur für die Skalierung von KI gerüstet ist?

Alle Führungskräfte sollten sich diese Frage stellen, unabhängig davon, wo sie sich auf ihrem Weg zur KI gerade befinden. Beginnen Sie damit, Führungskräften in verschiedenen Abteilungen des Unternehmens eine Reihe von einleitenden Fragen zu stellen. Diese offenen Fragen sollten als Orientierungsfragen betrachtet werden, die zu weiteren Fragen führen, die speziell auf Ihre Organisation und Ihre Initiativen zugeschnitten sind.

- Verfügen wir über einen konsistenten, zuverlässigen Zugriff auf die Betriebsdaten, auf die KI angewiesen ist, und zwar standort- und systemübergreifend, oder sind wir nach wie vor auf manuelle Auszüge und einmalige Integrationen angewiesen?

- Können durch KI generierte Erkenntnisse automatisch Aktionen in unseren Kernsystemen auslösen, oder sind sie auf menschliches Eingreifen angewiesen?

- Haben wir einen Überblick darüber, welche Anlagen angeschlossen sind, woher die Daten stammen und wo Lücken in der Vernetzung bestehen?

- Sind unsere Integrationen standardisiert und geregelt, oder sind sie maßgeschneidert und schwer zu warten?

- Wenn wir unser derzeitiges Pilotprojekt von einem Standort auf zehn Standorte ausweiten würden, würde die Infrastruktur dies ohne größere Umgestaltungen bewältigen können?

- Wird die Infrastrukturbereitschaft als unternehmensweite Priorität finanziert und gesteuert oder wird sie im Rahmen einzelner KI-Projekte nur als Nebensache behandelt?

Sollten diese Fragen Unsicherheiten, Fragmentierung oder Abhängigkeiten von manuellen Prozessen aufzeigen, sind wahrscheinlich Herausforderungen bei der Skalierung zu erwarten. Um diese anzugehen, müssen die KI-Bemühungen nicht ausgesetzt werden, doch erfordert dies im Rahmen einer umfassenderen Unternehmensmodernisierung besondere Aufmerksamkeit für Konnektivität, Transparenz der Infrastruktur und Ausführungsmechanismen.

Was ist der Unterschied zwischen IT-Modernisierung und Modernisierung im Hinblick auf KI?

Bei der IT-Modernisierung stehen in der Regel die Aktualisierung von Unternehmensanwendungen, die Migration von Systemen in die Cloud, die Verbesserung der Cybersicherheit sowie die Standardisierung von Kernplattformen wie ERP-, CRM- und Kollaborationstools im Vordergrund. Diese Maßnahmen sind unerlässlich und tragen häufig zur Steigerung der Effizienz, Ausfallsicherheit und Skalierbarkeit traditioneller Geschäftssysteme bei.

Die Modernisierung im Hinblick auf KI geht jedoch über IT-Plattformen hinaus. Dazu gehört auch, sicherzustellen, dass Betriebstechnologie (OT), Anlagen vor Ort, Altsysteme und verteilte Infrastruktur Daten auf Unternehmensebene zuverlässig generieren, übertragen und verarbeiten können. KI ist nicht nur auf moderne Anwendungen angewiesen, sondern auch auf einen konsistenten Zugriff auf Betriebsdaten, die Integration in Ausführungssysteme und Transparenz über Umgebungen hinweg, die sich möglicherweise über viele Jahre hinweg unabhängig voneinander entwickelt haben.

Ein Unternehmen kann seinen IT-Stack modernisiert haben und dennoch Schwierigkeiten bei der Skalierung von KI haben, wenn die Betriebssysteme weiterhin isoliert, uneinheitlich vernetzt oder schwer zu integrieren sind. Die Modernisierung im Hinblick auf KI erfordert daher eine umfassendere, funktionsübergreifende Perspektive, die IT, OT, Transparenz der Infrastruktur, Governance und Ausführungskapazitäten aufeinander abstimmt, um KI-gesteuerte Abläufe zu unterstützen.

Bei der Modernisierung im Hinblick auf KI geht es weniger darum, Systeme zu ersetzen, als vielmehr darum, sicherzustellen, dass die Unternehmensumgebung für einen kontinuierlichen Datenfluss und automatisierte Entscheidungsprozesse gerüstet ist.

Müssen wir alles modernisieren, um KI erfolgreich zu skalieren?

Nein. Die Skalierung von KI erfordert weder den Austausch aller Altsysteme noch die Einleitung einer umfassenden, disruptiven Transformationsinitiative. In den meisten Fällen erfolgt die Modernisierung für KI selektiv und zielgerichtet. Das Ziel besteht nicht darin, das Unternehmen neu aufzubauen, sondern sicherzustellen, dass die Systeme, Ressourcen und die Infrastruktur, auf die sich die KI stützt, zuverlässig Daten generieren, sich in andere Plattformen integrieren lassen und die automatisierte Ausführung unterstützen.

Führungskräfte sollten sich darauf konzentrieren, die konkreten operativen Systeme und Konnektivitätslücken zu identifizieren, die die Skalierbarkeit einschränken. In manchen Umgebungen sind möglicherweise eher eine Standardisierung der Integration, eine verbesserte Transparenz oder eine optimierte Konnektivität erforderlich als eine vollständige Erneuerung. In anderen Fällen reichen möglicherweise bereits geringfügige Anpassungen aus. Das Ziel ist nicht eine umfassende Modernisierung, sondern die Beseitigung der strukturellen Engpässe, die verhindern, dass KI konsistent in großem Maßstab funktioniert.

Bei der Modernisierung im Hinblick auf KI sollten die geschäftlichen Auswirkungen und die Anforderungen an die Skalierbarkeit im Vordergrund stehen, nicht die Annahme, dass sich alles ändern muss.

Nächste Schritte

Über den Autor

Benson Chan ist COO bei Strategy of Things, einem Unternehmen mit Sitz im Silicon Valley, das Regierungen und Unternehmen bei Innovationen im Bereich künstliche Intelligenz und Internet der Dinge unterstützt. Er verfügt über mehr als 30 Jahre Erfahrung in der Arbeit mit innovativen Technologien bei Fortune-500-Unternehmen, Start-ups und Regierungsorganisationen. Er war Vorsitzender des NIST IoT Board, das die Bundesregierung in Fragen des Internets der Dinge berät, Co-Vorsitzender des CompTIA und GTIA IoT Advisor und Mentor im IMPEL-Programm des Building Technology Office des US-Energieministeriums, das die Industrie mit Forschern der National Laboratories zusammenbrachte, um unternehmerisches Denken zu fördern.

Benson Chan ist COO bei Strategy of Things, einem Unternehmen mit Sitz im Silicon Valley, das Regierungen und Unternehmen bei Innovationen im Bereich künstliche Intelligenz und Internet der Dinge unterstützt. Er verfügt über mehr als 30 Jahre Erfahrung in der Arbeit mit innovativen Technologien bei Fortune-500-Unternehmen, Start-ups und Regierungsorganisationen. Er war Vorsitzender des NIST IoT Board, das die Bundesregierung in Fragen des Internets der Dinge berät, Co-Vorsitzender des CompTIA und GTIA IoT Advisor und Mentor im IMPEL-Programm des Building Technology Office des US-Energieministeriums, das die Industrie mit Forschern der National Laboratories zusammenbrachte, um unternehmerisches Denken zu fördern.

Referenzen